Im więcej naukowcy pracują z AI, tym mniej jej ufają. Alarmujący raport Wiley

Wraz z dynamicznym rozwojem sztucznej inteligencji, powszechnie oczekuje się, że jej akceptacja i zaufanie do niej będą rosły. Jednak najnowsze dane z raportu wydawnictwa akademickiego Wiley pokazują coś zupełnie przeciwnego.

Naukowcy, czyli grupa, która najintensywniej pracuje z AI i – przynajmniej teoretycznie – powinna najbardziej na takiej współpracy skorzystać, coraz mniej jej ufa. Wyniki ankiety z 2025 roku są zaskakujące i alarmujące.

W zapowiedzi swojego raportu na rok 2025 dotyczącego wpływu technologii na badania naukowe, Wiley ujawniło wstępne ustalenia dotyczące postaw wobec sztucznej inteligencji. Okazuje się, że zaufanie naukowców do AI spadło w porównaniu z rokiem 2024, kiedy to technologia była jeszcze mniej zaawansowana.

Rosnące obawy mimo większego wykorzystania

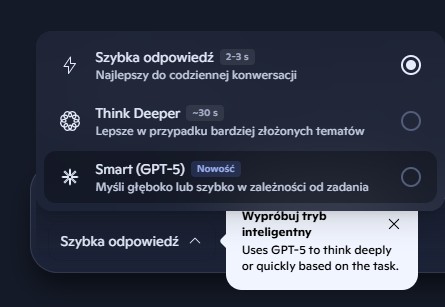

W 2024 roku 51% ankietowanych naukowców obawiało się potencjalnych „halucynacji” – powszechnego problemu, w którym duże modele językowe (LLM) prezentują całkowicie zmyślone informacje jako fakty. W 2025 roku liczba ta wzrosła do 64%, mimo że jednocześnie wzrosło wykorzystanie AI w badaniach – z 45% do 62%. Warto też dodać, że obawy wzrosły pomimo deklaracji firm-twórców dużych modeli LLM, że znacznie udało im, się zniwelować problem halucynowania AI. Przypomnę tylko, że był to jeden z głównych punktów prezentacji OpenAI podczas debiutu modelu GPT-5.

Wzrosły również obawy dotyczące bezpieczeństwa i prywatności (o 11% w stosunku do ubiegłego roku), a także niepokoje związane z kwestiami etycznymi oraz transparentności działania sztucznej inteligencji.

Spadek wiary w przewagę AI

Co więcej, odnotowano masowy spadek entuzjazmu w porównaniu z ubiegłym rokiem. W 2024 roku naukowcy ankietowani przez Wiley wierzyli, że AI już teraz przewyższa ludzkie zdolności w ponad połowie zastosowań. W 2025 roku przekonanie to drastycznie spadło – do mniej niż jednej trzeciej.

Wyniki te potwierdzają wcześniejsze badania, które sugerowały, że im więcej ludzie dowiadują się o tym, jak działa AI, tym mniej jej ufają. Zjawisko to wydaje się szczególnie widoczne wśród profesjonalistów, którzy na co dzień zmagają się z niedoskonałościami algorytmicznych asystentów.

Jednym z kluczowych problemów pozostają wspomniane „halucynacje”, które już wywołały poważne zamieszanie w sądach, praktyce medycznej, a nawet w branży turystycznej. Co więcej, majowe testy wykazały, że modele AI halucynują częściej, mimo że technicznie stają się coraz potężniejsze i – przynajmniej według deklaracji twórców, mają halucynować mniej. Jednak opinie profesjonalnych użytkowników świadczą wręcz o czymś przeciwnym.

Dodatkowo, eksperci wskazują, że użytkownicy często preferują „pewne siebie” LLM-y, nawet jeśli te podają nieprawdziwe informacje, co stawia firmy technologiczne przed dylematem: rzetelność czy popularność. Warto dodać, że raport Wiley sugeruje, że ogólny „hype” wokół AI może nie odzwierciedlać trzeźwej oceny tych, którzy z nią pracują najintensywniej. Pamiętajmy też, że badanie miało charakter oparty na opiniach, a nie na niezależnych od poglądów pomiarach. Niemniej opinie naukowców mają duże znaczenie, to nauka w znacznej mierze definiuje rozwój i jest motorem napędowym naszej cywilizacji. Nauka, ale wciąż nie AI. Na koniec dający do myślenia wpis prof. Przegalińskiej:

Jestem już chwilę z powrotem w Stanach. Przez ostatni tydzień przynajmniej w kilku miastach na wschodnim wybrzeżu (podkreślam, że tu, bo w Dolinie Krzemowej są chyba inne nastroje) widać było wyraźnie publiczną niechęć do AI, a może raczej rozczarowanie wobec tej technologii. Na… pic.twitter.com/OccljceaTV

— Aʟᴇᴋꜱᴀɴᴅʀᴀ ᴘʀᴢᴇɢᴀʟɪɴꜱᴋᴀ (@Przegaa) October 5, 2025

Czy na pewno właśnie takiej AI oczekiwaliśmy? Zostawiam Was z tym pytaniem.