Współczesny robot zda maturę z matematyki, ale polegnie na kanapce z masłem orzechowym. Czym jest Paradoks Moraveca?

W 1996 roku komputer wygrał w szachy z Kasparowem. W 2025 roku AI rozwiązuje zadania olimpijskie z matematyki. Dlaczego więc wciąż żaden robot nie potrafi sprawnie opróżnić zmywarki?

Odpowiedź kryje się w zjawisku, które inżynierowie nazywają Paradoksem Moraveca.

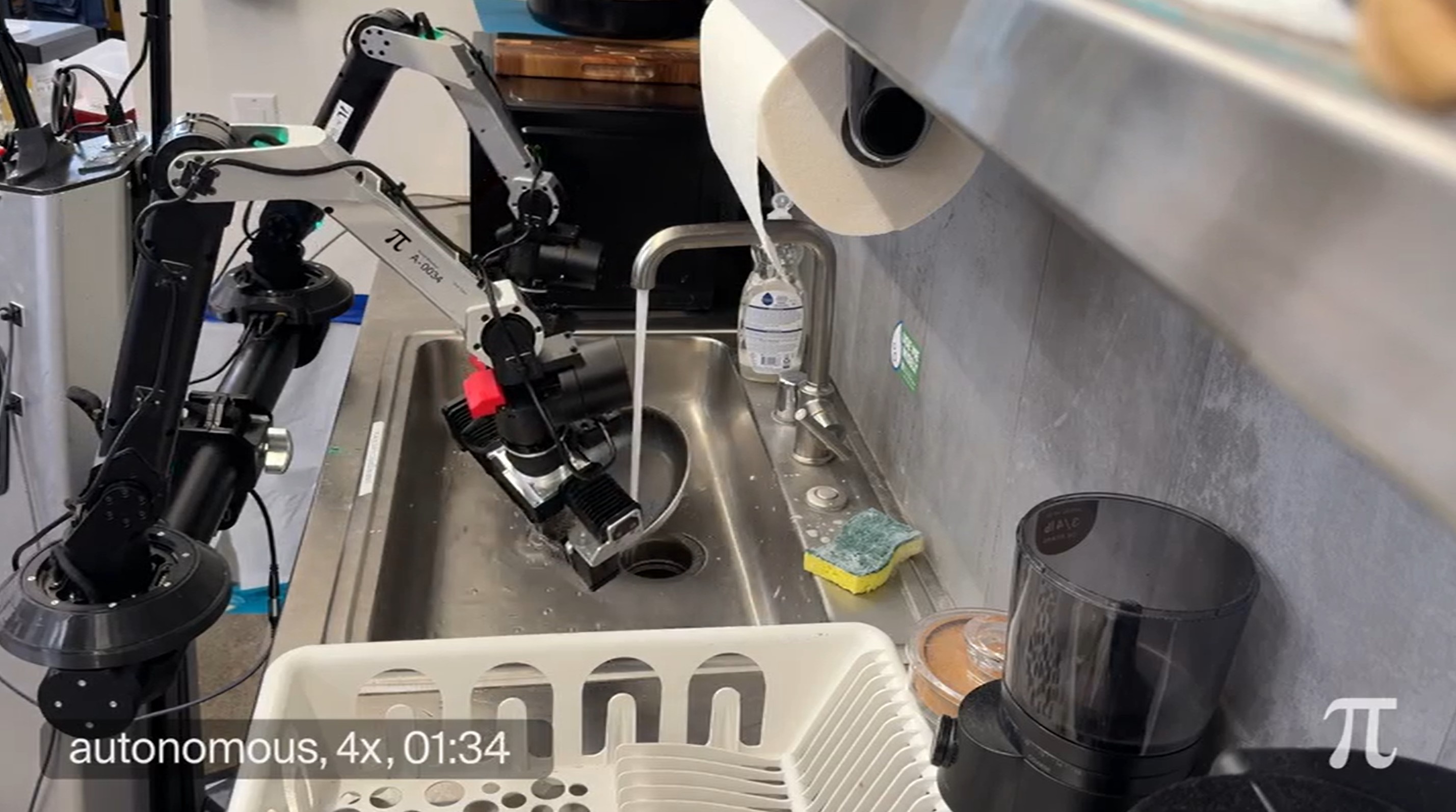

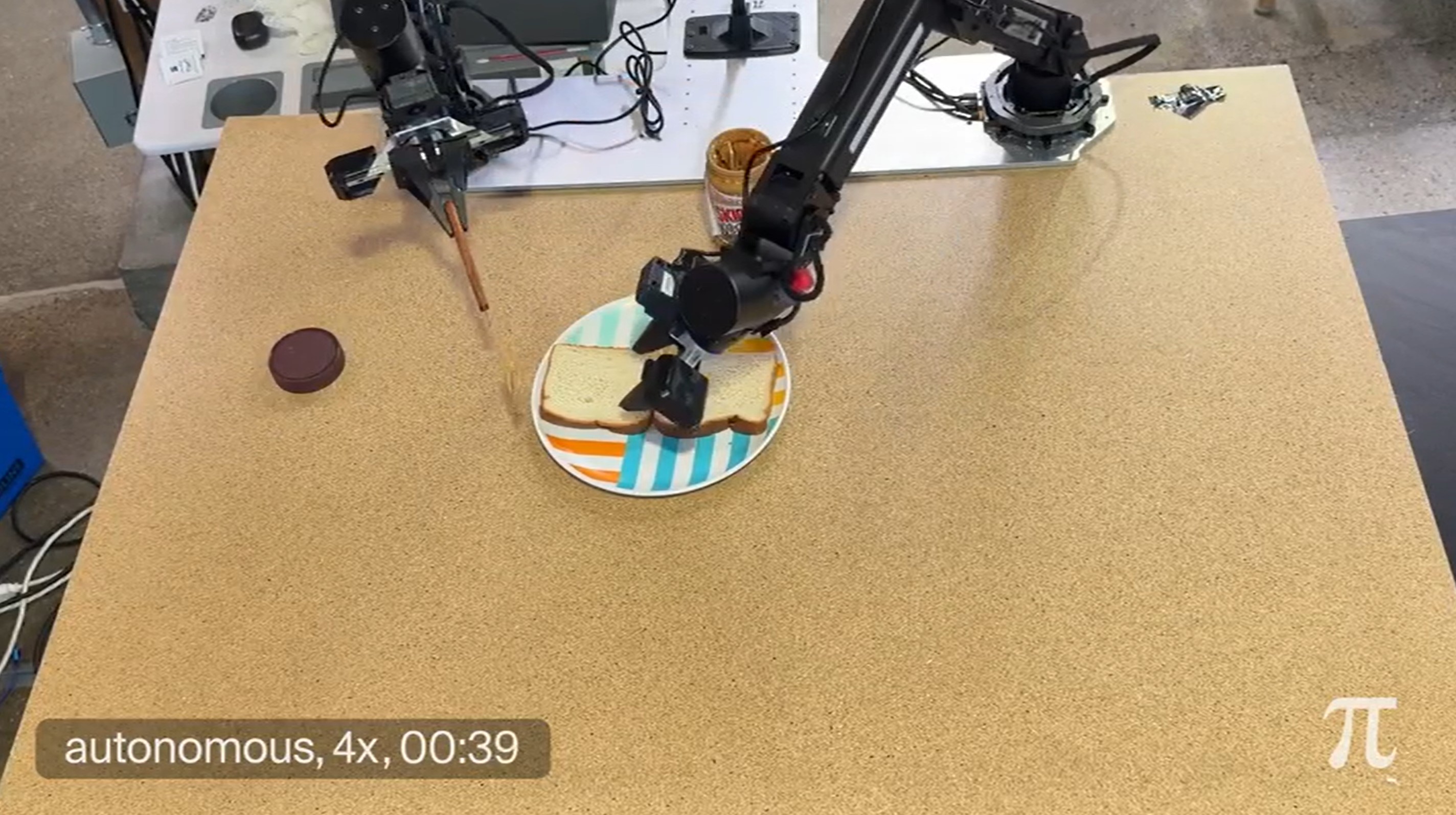

Startup Physical Intelligence (pi.website) opublikował właśnie fascynujące wyniki swoich testów, które nazwał „Robotyczną Olimpiadą”. Zamiast skoków wzwyż, konkurencje obejmowały: otwieranie drzwi, wywracanie skarpety na drugą stronę i… sprzątanie psiej kupy.

Co jest łatwe, a co trudne?

Dla człowieka pomnożenie w pamięci 345 przez 892 jest trudne. Zrobienie kanapki z masłem orzechowym jest banalne. Dla robota jest odwrotnie. Paradoks Moraveca mówi, że wysokie zdolności poznawcze (logika, szachy, matematyka i inne nauki ścisłe) wymagają stosunkowo niewielkiej mocy obliczeniowej. Natomiast niskopoziomowe zdolności sensomotoryczne (chodzenie, chwytanie śliskiej gąbki, wyczucie siły nacisku noża na chleb) wymagają gigantycznych zasobów, których nasze mózgi używają podświadomie. Nie potrafimy wytłumaczyć robotowi, „jak” trzymać jajko, żeby go nie zgnieść – po prostu to „czujemy”. Robot tego nie czuje.

Igrzyska robotów

Firma Physical Intelligence postanowiła sprawdzić swój najnowszy model AI π (pi) w codziennych, domowych zadaniach. Oto jak im poszło:

- Złoto: otwieranie drzwi samozamykających się (wymaga pchnięcia klamki i przytrzymania drzwi ciałem/ramieniem). Zaliczone.

- Srebro: wywracanie skarpety na drugą stronę. Brzmi prosto? Dla chwytaka robota to koszmar topologiczny. Mimo to, po „nauce”, model sobie poradził.

- Brąz: mycie tłustej patelni. Robot musiał operować wodą, gąbką i śliską powierzchnią. Sukces.

- Porażka (częściowa): obieranie pomarańczy. Zadanie okazało się niemożliwe dla obecnych chwytaków bez użycia dodatkowego narzędzia.

Dlaczego to przełom?

Kluczowe jest to, że robot nie został zaprogramowany „na sztywno” do każdej z tych czynności. Użyto ogólnego modelu (Foundation Model), który został tylko „douczony” (fine-tuned).

Model bazowy, który nie miał wcześniejszego treningu na ogromnej ilości danych fizycznych, osiągnął w tych testach 0% skuteczności. Model wytrenowany przez Physical Intelligence osiągnął 52%.To pokazuje, że wchodzimy w nową erę. LLM-y (jak ChatGPT) nauczyły się języka z całego internetu. Teraz modele VLA (Vision-Language-Action) uczą się fizyki świata, oglądając i symulując miliony interakcji.

Może więc robot, który zrobi nam kanapkę i poskłada pranie, nie jest już tylko wizją z filmów Sci-Fi, ale kwestią najbliższych 2-3 lat. Obejrzycie klipy Physical Intelligence na ich witrynie.

Terminator wstał z kolan… i kopnął szefa. Chiński robot T800 udowadnia, że nie jest animacją CGI