Google I/O 2023: uczyńmy AI pomocną każdemu

Tegoroczne Google I/O jak w ubiegłym roku rozpoczęło się od przemówienia Sundara Pichaia, szefa technologicznego giganta. Co nowego? Poniżej szybki skrót z keynote’a.

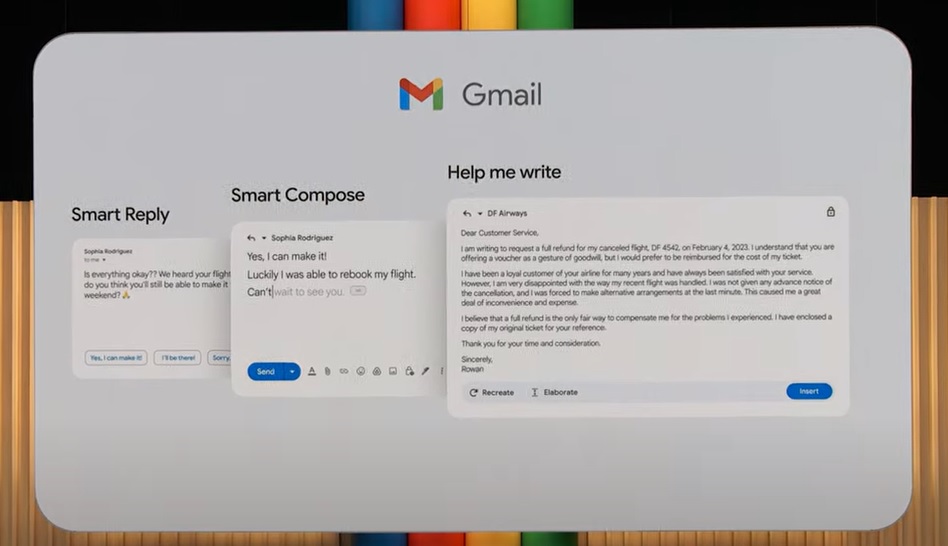

Gmail: usługa pomoże Ci napisać maila. To uzupełnienie znanych wcześniej funkcji Smart Replay (szybkie, automatyczne odpowiedzi) oraz Smart Compose (automatyczne propozycje zdań w korespondencji). Teraz generatywna AI pomoże w całości napisać i zredagować maila. Pichai zaprezentował przykład, w którym użytkownik prosi Gmaila o napisanie maila, w którym autor domaga się zwrotu kosztów odwołanego lotu. AI uwzględnia kontekst i tak tworzy treść, by zwiększyć szanse na odzyskanie pieniędzy za bilety.

Street View: nowością jest widok Immersive View dla własnych, planowanych tras. Nowa funkcja nazwana Immersive View for routes będzie udostępniona dla 15 miast na świecie do końca bieżącego roku. Wśród miast, które zostaną objęte tą funkcją w Mapach Google i Street View na pewno będą: Londyn, Tokio i San Francisco.

Google Photos: w funkcjach edycyjnych tej usługi pojawi się funkcja Magic Editor, która pozwala w imponujący sposób manipulować obiektami na zdjęciach. Źle wykadrowane zdjęcie? Żaden problem, wystarczy przesunąć najważniejszy dla nas obiekt w lepsze miejsce w kadrze, a generatywna AI, dosłownie, dorobi brakujące elementy na fotografii. Pytanie, czy to jeszcze fotografia, zostawiam Wam. Magic Photos pojawi się w Zdjęciach Google jeszcze w tym roku.

PaLM 2: Google ogłosiło drugą generację swojego modelu językowego AI. PaLM 2 ma być dostępny w czterech wariantach o różnym stopniu złożoności: Gecko, Otter, Bison oraz Unicorn. Gecko to niewielki model, który można uruchomić niezależnie na urządzeniu takim jak smartfon. Tak, dobrze czytacie, moc obliczeniowa współczesnego smartfona ma być wystarczająca by uruchomić na nim lokalną, spersonalizowaną sztuczną inteligencję opartą na modelu PaLM 2 Gecko i rozwiązanie to działa offline. Nie trzeba być w ogóle podłączonym do Sieci. Tym samym Google niejako zaadresowało problem przerostu generatywnych modeli AI, o którym wspominałem Wam niedawno w materiale o „zagrożeniach” dla Google’a i OpenAI ze strony rozwiązań open source.

PaLM 2 od dziś jest dostępny w wersji Preview.

Google ogłosiło również Google DeepMind i nowy, wielomodalny model AI o nazwie Gemini, który wciąż jest trenowany. Również ten model dostępny będzie w kilku wariantach o różnym stopniu złożoności i wymaganej do jego działania mocy obliczeniowej. To co jest szczególnie ciekawe, to fakt, że Gemini i bazujące na nim konstrukty AI będą służyć również pomocą w określeniu, czy to, co widzimy (np. zdjęcie), jest faktyczną rejestracją rzeczywistości, czy wygenerowanym przez AI obiektem. Przyznam, że taki autonomiczny factchecking wbudowany w AI, to rzecz szczególnie istotna wobec rosnącej popularności wszelkich fałszerstw z wykorzystaniem AI.

Google Bard: oczywiście nie zabrakło też słów na temat Barda, czyli konwersacyjnej AI od Google’a. Bard, udostępniony wcześniej ograniczonej liczbie użytkowników, otrzymał teraz solidne wsparcie: nowy model PaLM 2. Ma to znacząco usprawnić zdolności tej konwersacyjnej AI. Bard ma wydajnie pomóc programistom, nie tylko w tworzeniu kodu, ale też jego debugowaniu, czy wyjaśnianiu. Bard „zna” ponad 20 różnych języków programowania (m.in. C++, Ruby, Python, Java, JavaScript i wiele więcej). Nie będę tu rozwijał tematu, ale zdolności Barda z pewnością zainteresują programistów. Obecni na prezentacji z aplauzem powitali również wiadomość, że Bard otrzymał również ciemny motyw interfejsu.

Odpowiedzi Barda na zapytania użytkownika (niekoniecznie związane z programowaniem) mogą być automatycznie przenoszone do zredagowanej notki w Google Docs lub wprost do treści maila w usłudze Gmail. Również ten „ficzer” wywołał aplauz publiczności.

Bard ma być już nie tylko wyłącznie konwersacyjną AI, lecz równie sprawnie ma sobie radzić z obrazem i to nie tylko w odpowiedziach, ale i zapytaniach użytkownika. Np. Bart potrafi już korzystać ze znanej wcześniej usługi Google Lens, jak i wielu innych usług Google (np. z Map Google). Bard jeszcze w tym roku będzie potrafił także generować zupełnie nowe obrazy wykorzystując Adobe Firefly.

Najważniejsze jest jednak to: od dziś lista oczekiwania ma zostać zdjęta i Bard ma trafić do każdego chętnego z ponad 180 państw świata (w wersji anglojęzycznej; sprawdziłem, w Polsce, przynajmniej u mnie wciąż nie jest dostępny). Ponadto od dziś Bard jest dostępny również w języku japońskim i koreańskim. Polska wersja? Będzie z całą pewnością (wśród 40 innych odmian językowych, które wkrótce się pojawią), ale po prostu jeszcze na nią musimy poczekać.

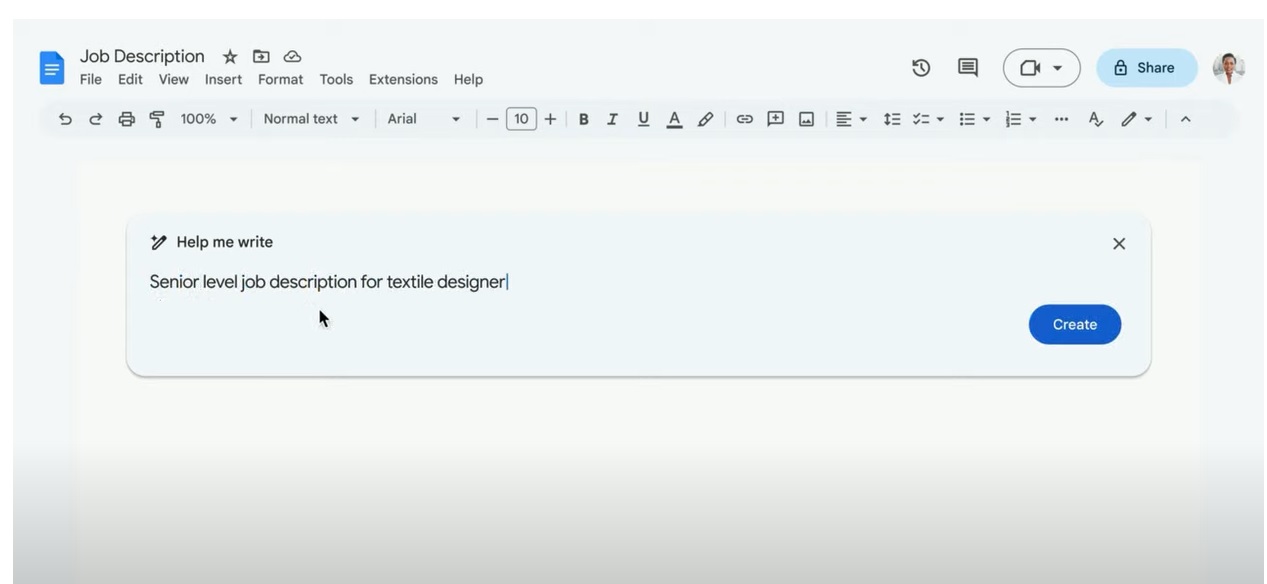

Google Workspace: znacie to narzędzie, służy do współpracy z innymi. Teraz nie tylko z ludźmi, ale również AI. Google ogłosiło nową usługę: Duet AI for Workspace. Co to oznacza w praktyce? AI pomoże dokończyć raport, notatkę, automatycznie uzupełni prezentację o wypowiedzi prowadzącego, jeżeli akurat nie masz weny, możliwości sporo, a to jeszcze nie koniec.

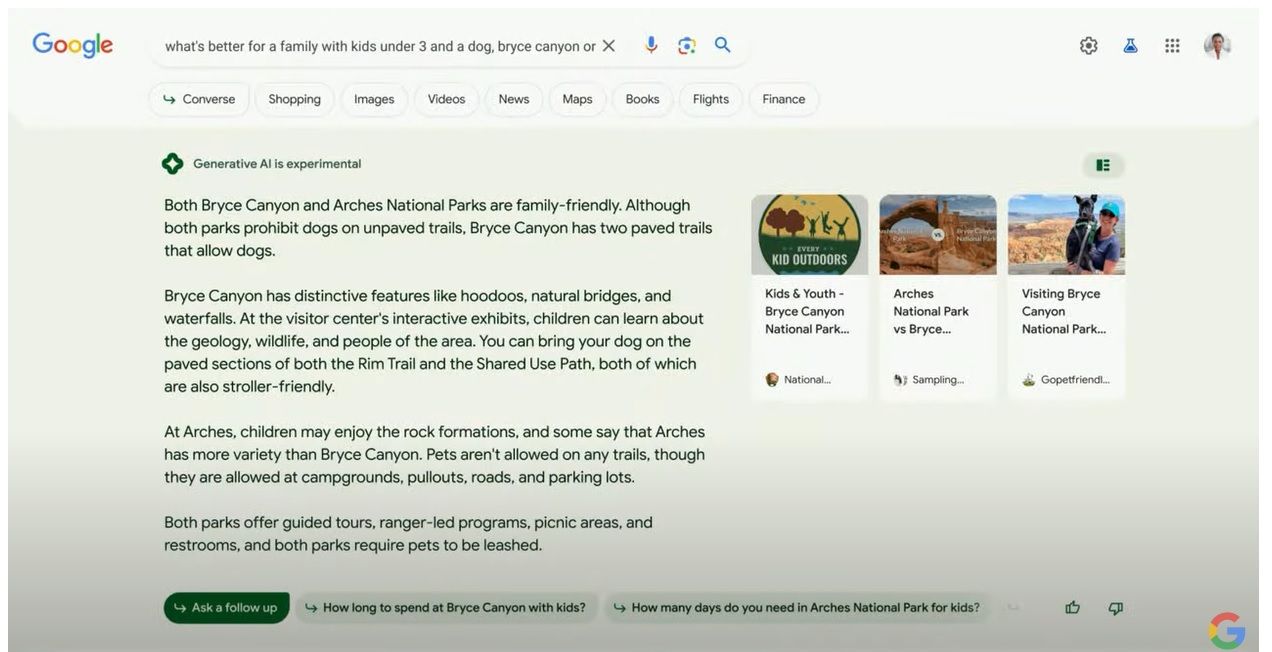

Google Search dogoniło również Binga w procesie integracji trybu konwersacyjnego z wyszukiwarką Google. W wynikach wyszukiwania pojawi się nowy moduł konwersacyjny.

To co szczególnie istotne w dzisiejszych czasach to factchecking i odpowiedzialność twórców AI za wyniki ich produktów. Możliwość upewnienia się, czy cokolwiek, co znajdziemy w Sieci jest prawdą, czy tylko fałszem wygenerowanym przez sztuczną inteligencję jest istotna. Google w najbliższych miesiącach udostępni dwa narzędzia. Pierwsze z nich dotyczy analizy obrazów znalezionych w Sieci, co pozwala upewnić się, czy dany obraz jest prawdziwy, czy jest manipulacją. Google wyświetli nam informacje konktekstowe dotyczące danej fotografii, ponadto Google Lens zwróci użytkownikowi informacje, kiedy dany obraz został po raz pierwszy zindeksowany przez Google. Drugie narzędzie pozwala na błyskawiczne określenie, czy dany obraz został stworzony przez człowieka, czy przez AI. Obrazy wygenerowane przez AI będą odpowiednio oznaczane.

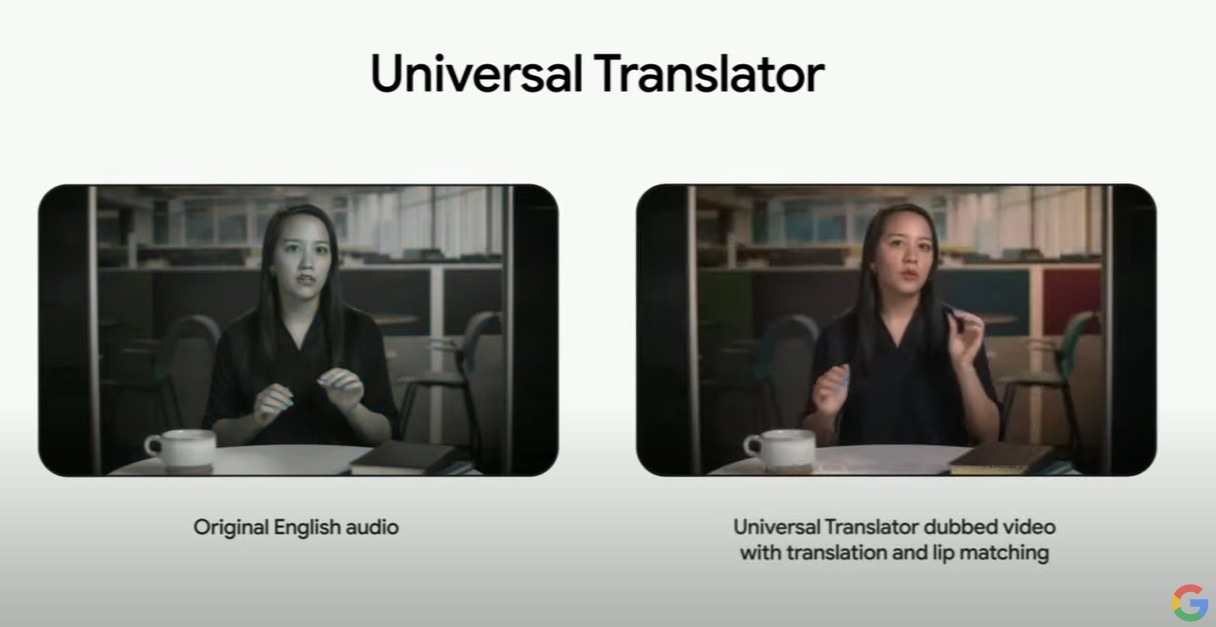

Zaprezentowano również narzędzie o nazwie Universal Translator. Przyznam, że ten fragment wbił mnie w fotel. Nie chodzi tylko o tłumaczenie wideo, ale taką modyfikację, która jednocześnie dopasowuje ruch ust mówiącej osoby do docelowego języka, jaki chcecie usłyszeć. Niezłe. Co ważne, narzędzie to również jest chronione przed wykorzystaniem go np. do kreowania deepfake’ów.

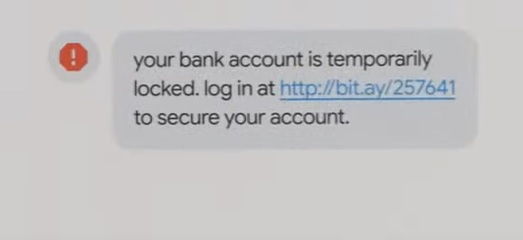

Co nowego w Androidzie? Na przykład: automatyczne wykrywanie niechcianych, spamowych połączeń telefonicznych, czy wiadomości SMS zawierających niebezpieczny link. Aż chce się zapytać, dlaczego dopiero teraz? Ponadto:

- na Wear OS ma pojawić się WhatsApp (tego lata);

- Funkcja Find My Device ma wykrywać nie tylko smartfon, ale również bezprzewodowe słuchawki czy smartwatch z Wear OS

- Gdy ktoś wrzuci Wam do plecaka Apple AirTag lub inne działające bezprzewodowo urządzenie, by was śledzić, Android ma Was o tym uprzedzić. Co ciekawe ten nowy standard powiadomień chroniących prywatność użytkownika ma działać nie tylko na smartfonach z Androidem. Tak, funkcja Unknown tracker alerts ma działać na każdym smartfonie. Od kiedy to będzie dostępne? Od lata 2023 roku.

- Magic Compose, nowa funkcja w Wiadomościach, pozwalająca użyć generatywnej AI do wzbogacenia wysyłanych wiadomości tekstowych.

- Cinematic Wallpapers z prywatnych zdjęć na smartfonach Google Pixel w przyszłym miesiącu.

- Pokazano nowy smartfon, Pixel 7a z nowym chipem Google Tensor G2 i z licznymi funkcjami AI, cena od 499$ (niedostępny w Polsce).

- Oprócz tego pokazano też nowy Pixel Tablet (również z chipem Tensor G2) ze stacją ładująco-dokującą z głośnikiem o funkcjonalności głośnika Google Home. Cena od 499$ (niedostępny w Polsce), głośnik gratis.

- Google Pixel Fold to z kolei zupełna nowinka, oczywiście z AI i Google Tensor G2 na pokładzie. Google chwali się, że to najcieńszy smartfon ze składanym ekranem na rynku. IPX8, 7,6″ ekran po rozłożeniu. Cena? 1799$ (nie kupimy go w Polsce), za to w USA, UK i w Niemczech sprzęt oferowany będzie z zegarkiem Pixel Watch, 2 TB Google One na pół roku i YouTube Premium na 3 miesiące.

I to by było na tyle, celowo i z premedytacją pominąłem rozwiązania typowo biznesowe, zainteresowani mogą obejrzeć powtórkę z prezentacji poniżej, a jeżeli już teraz chcielibyście pogadać z Bardem, to niestety trzeba się jeszcze uzbroić w cierpliwość. Nowości Google możecie też obadać zaglądając na serwis Google Labs.