Apple opracowuje AI do rozpoznawania nowych gestów dłoni z sygnałów EMG

Apple opublikowało badanie EMBridge, prezentowane na konferencji ICLR 2026, które pokazuje, jak sztuczna inteligencja może rozpoznawać gesty dłoni wcześniej niewidziane w danych treningowych.

Co to jest EMG? Elektromiografia (EMG) mierzy aktywność elektryczną mięśni podczas skurczu. Zastosowania obejmują medycynę, rehabilitację, sterowanie protezami, a coraz częściej też wearables i AR/VR. Przykładem jest Meta Ray-Ban Display, które interpretuje sygnały mięśniowe z nadgarstka.

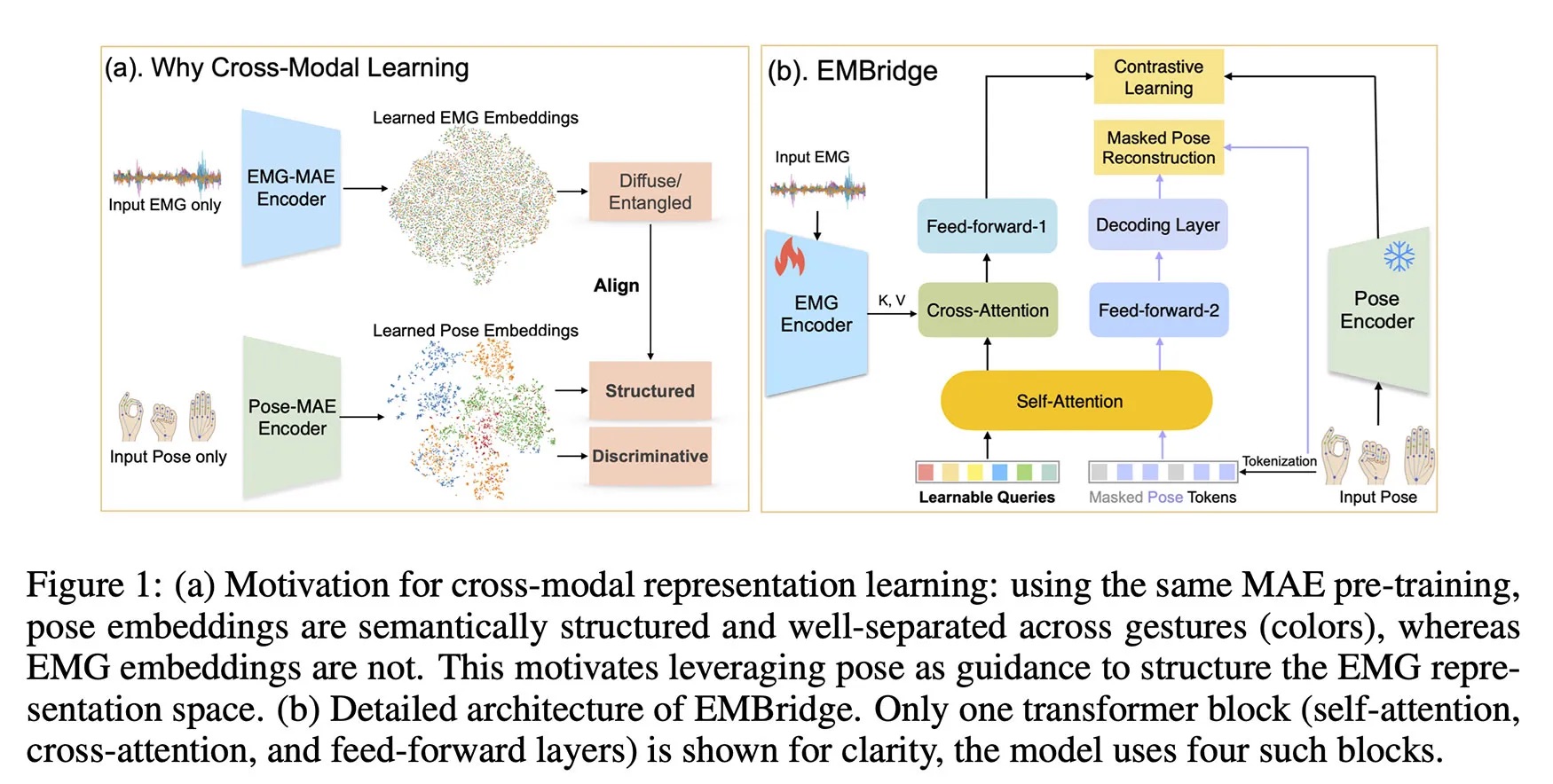

EMBridge łączy sygnały EMG z danymi o pozie dłoni w ramach uczenia reprezentacji cross-modal. Model był wstępnie trenowany na danych EMG i pozie osobno, a następnie reprezentacje zostały wyrównane, by EMG encoder uczył się od pose encoder. Technika masked pose reconstruction pozwalała modelowi odtwarzać brakujące elementy pozy, korzystając wyłącznie z EMG.

Jakie wyniki osiągnięto?

- EMBridge osiągnęło zero-shot gesture recognition, czyli rozpoznawanie gestów wcześniej nieobserwowanych.

- Testy na emg2pose i NinaPro pokazały przewagę nad istniejącymi metodami, przy użyciu tylko 40% danych treningowych.

- Model uwzględnia podobieństwa gestów, co poprawia generalizację i redukuje błędy.

Choć badanie nie wspomina konkretnych produktów Apple, technologia może w przyszłości umożliwić:

- sterowanie Apple Vision Pro, Macami, iPhone’ami i innymi wearables,

- nowe interakcje w VR/AR,

- ułatwienia dla osób z niepełnosprawnościami.

Ograniczeniem jest potrzeba danych EMG zsynchronizowanych z pozycją dłoni, które są trudne do zebrania, ale EMBridge pokazuje znaczący potencjał w sterowaniu urządzeniami za pomocą gestów.